Ричард Никсон, 37-й президент США, рассказал, что первый полет астронавтов на Луну провалился — экипаж погиб во время миссии. На самом деле, в 1969 году она прошла успешно, а обращение Никсона оказалось проектом американских исследователей, демонстрирующим работу искусственного интеллекта.

Видео было создано с помощью технологии deepfake и опубликовано в 51-ю годовщину миссии «Аполлон-11». Никсон произносит речь, которой в реальности никогда не было. «Добрый вечер, мои дорогие американцы, — говорит Никсон на сфабрикованном видео. — Судьба распорядилась так, что люди, отправившиеся на Луну, чтобы исследовать ее, останутся на ней и будут покоиться с миром».

На самом деле, в 1969 году астронавты Нил Армстронг и Базз Олдрин высадились на Луну провели на ее поверхности 2,5 часа, после чего вернулись на Землю. У президента было готово несколько вариантов речи, с которой он выступит по окончании миссии — на случай ее успеха или провала.

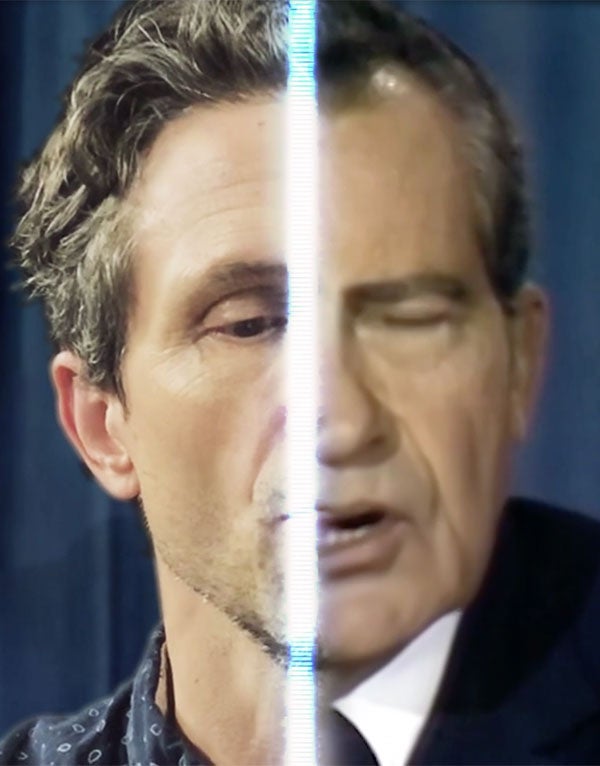

Видео создали Франческа Панетта и Хэлси Бургунд из Массачусетского технологического института объединившись двумя компаниями, занимающимися разработкой искусственного интеллекта, — Canny AI и Respeecher. Для записи голоса Respeecher синтезировала речь, используя технологию глубокого обучения. Она имитирует связи мозга, чтобы обрабатывать информацию и самостоятельно принимать решения. Другая компания — под названием Canny AI — имитировала движения губ Никсона, сделав его обращение правдоподобным.

«Эта альтернативная история показывает, как новые технологии могут запутать нас, побуждая нашу аудиторию тщательно проверять информацию, которую они получают каждый день», — сказала Франческа Панетта, креативный директор Центра расширенной реальности.

Проект «В случае катастрофы на Луне» показывает, что перспективная технология может иметь и позитивные, и негативные последствия для цифровой среды. Сегодня пользователи Сети неоднократно сталкиваются с проблемами, связанными, например, с распространением ложной информации или использованием их лиц для производства контента. Так, согласно отчету компании Deeptrace, порнография с deepfake занимает 96% от общего числа.

«Дезинформация в СМИ — давнее явление, но, усугубленное технологией deepfake и легкостью распространения контента в интернете, оно стало важной проблемой нашего времени», — заявил Фокс Харрелл, директор Центра передовой виртуальности Массачусетского технологического института (MIT).

Глубокое обучение также может использоваться для создания звуковых подделок, в кукольных постановках и анимации — для синхронизации движений губ актеров озвучивания и персонажей. В последнее время технология популярна в СМИ и даже применяется для помощи людям, которые потеряли способность говорить после болезни.