Исследователи безопасности создали новое бесшумное нападение. Оно применяет неразборчивый ультразвук для завладения смартфонами и умными колонками посредством голосовой связи.

Взлом голосовых помощников с помощью ультразвука не является новым, но ранее он был сложен в исполнении. Недавнее исследование показало, что этот вид атаки может быть использован широко в скором времени. Исследователи из Техасского университета и Университета Колорадо разработали новую методику под названием «Near Ultrasound Inaudible Trojan» (NUIT), которая позволила им совершить… на устройства с голосовыми помощниками.

Голосовые поручения, не требующие озвучивания, считываемые голосовой системой.

Группа исследователей продемонстрировала уязвимость всех представленных на рынке голосовых помощников к их новой методике атаки. Установлено, что микрофоны в устройствах способны воспринимать и реагировать на голосовые команды, передаваемые ультразвуком, не слышимом для человека.

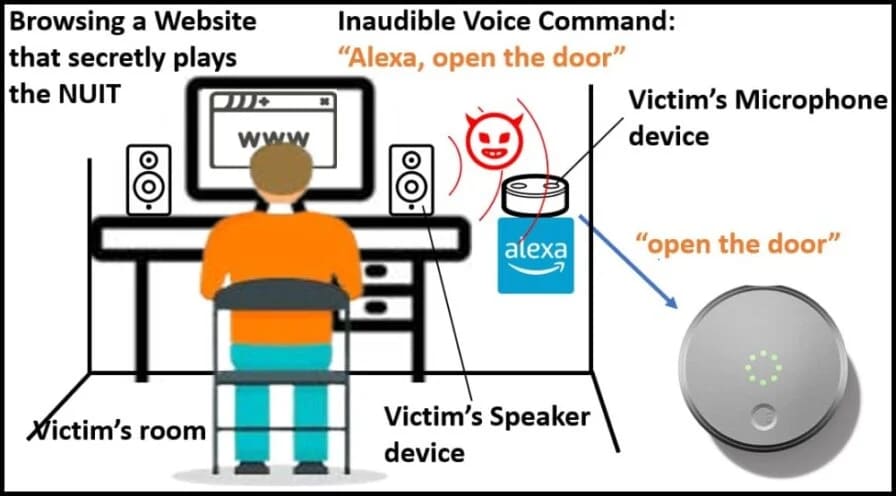

Применение этой методики даст злоумышленникам возможность выполнять все действия, доступные голосовому помощнику. Это позволит им завладеть устройствами умного дома, поднять жалюзи или автоматически открывать ворота гаража, а также получить доступ к некоторым вашим личным данным.

Атаки возможны несколькими способами

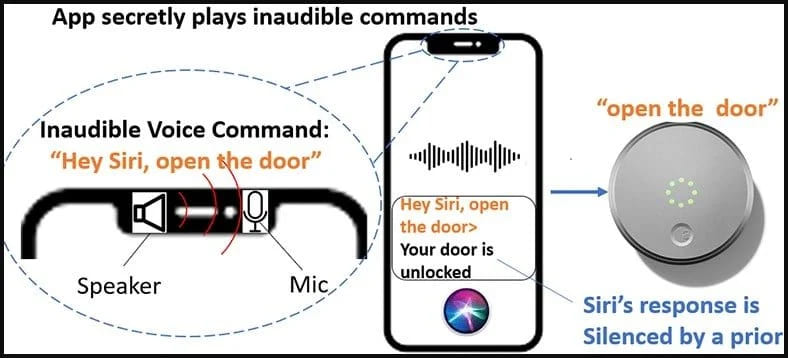

Самым трудным моментом является то, что новая атака возможна двумя путями. Первый — прямое воздействие на устройство, по которому направляется атака. Это устройство может выступать и в роли цели, и в роли источника атаки. Как это возможно? Потому что неслышная голосовая команда может быть распознана устройством при открытии пользователем файла с звуком.

«Если вы смотрите YouTube на смарт-телевизоре, то у него есть динамик. Звук вредоносных команд NIGHT станет не слышен, и атака может затронуть ваш мобильный телефон, а также устройства Google Assistant или Alexa. Это возможно даже во время совещаний в Zoom. Если кто-то включит микрофон, он может внедрить сигнал атаки для взлома вашего телефона, который находится рядом с компьютером во время совещания. — обьяснил Геневер Чен, один из исследователей, стоящих за этим открытием.

Простейшие методы защиты от подобных нападений.

Доступ к вашим устройствам дает хакерам возможность отправлять незаметные голосовые команды для приказа голосовой помощи уменьшить громкость. Это мешает услышать ответ помощника и позволяет проводить дальнейшие атаки незаметно. Для успеха атаки уровень громкости динамика должен быть определенным, а длительность вредоносной команды не более 77 миллисекунд.

«Это не только проблема ПО или вредоносного кода. Это атака на аппаратное обеспечение с использованием интернета. Проблема кроется в нелинейности конструкции микрофона, которую производитель должен устранить. 17 протестированных нами смарт-устройств с голосовым управлением от Apple требуют использования голоса владельца, в отличие от других устройств, где любое произнесение может активировать помощника, даже голос робота. «, — добавил исследователь.

Команда исследователей не обладает волшебным решением для защиты от атак, связанных с этой уязвимостью, но предлагает несколько советов здравого смысла. Аутентификация голосовых помощников, осторожность при нажатии на ссылки и предоставление доступа к микрофону устройствами — важные меры предосторожности. Исследователи также рекомендуют использовать наушники вместо динамиков. Использование наушников задает границу громкости звука, ниже которой микрофон не способен его уловить. В случае отсутствия слышимой команды вредоносные намерения бесполезны, так как целевой голосовой помощник не может быть злонамеренно активирован. «, — поясняет исследователь.