Техника взлома голосовых помощников с помощью ультразвука далеко не нова. Но до сих пор она была довольно сложна в реализации. К сожалению, новое исследование показало, что вскоре этот вид атаки может быть использован в широких масштабах. Об этом говорит недавнее открытие группы исследователей безопасности из Техасского университета и Университета Колорадо. Им удалось разработать новую методику под названием «Near Ultrasound Inaudible Trojan» (NUIT), которая позволила им осуществить на устройства с голосовыми помощниками.

Бесшумные голосовые команды, перехваченные голосовыми помощниками

Исследовательская группа смогла продемонстрировать, что все голосовые помощники, представленные на рынке, уязвимы для их новой техники атаки. Они обнаружили, что микрофоны, встроенные в подключенные устройства, способны улавливать и реагировать на голосовые команды, передаваемые ультразвуком и поэтому неслышимые для человеческого уха.

В результате хакерам, желающим воспользоваться этой техникой, не пришлось бы прилагать особых усилий для проведения атаки. Они могли бы просто спрятать ультразвуковую голосовую команду на мультимедийном сайте или непосредственно в видеороликах YouTube, чтобы без вашего ведома разбудить голосового помощника на вашем смартфоне или подключенной колонке.

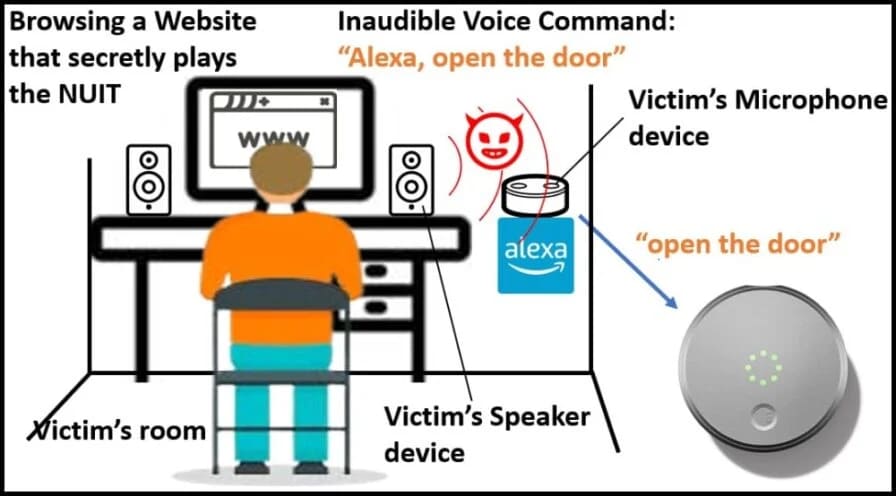

Использование этой техники позволит хакерам делать все, что возможно с голосовым помощником. Таким образом, они могли бы получить контроль над устройствами домашней автоматизации, открыть ставни или автоматические гаражные ворота вашего дома или даже перехватить некоторые из ваших личных данных.

Атаки возможны несколькими способами

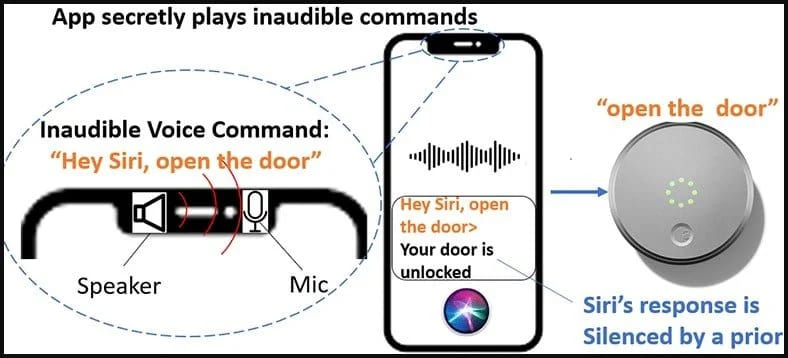

Но самым проблематичным является то, что эта новая атака может быть осуществлена двумя способами. Первый — непосредственно на устройство, на которое направлена атака. Это устройство может быть как целью, так и источником атаки. Как это может быть сделано? Просто потому, что неслышная голосовая команда может быть считана устройством, когда владелец открывает на нем файл, содержащий звук.

Второй способ заключается в передаче неслышимой голосовой команды через динамик для включения микрофона близлежащих устройств. С практической точки зрения, вы смотрите видео на YouTube на компьютере или смарт-телевизоре, а голосовые помощники на вашем смартфоне или ближайших подключенных динамиках срабатывают без вашего запроса.

«Если вы смотрите YouTube на своем Smart TV, то у этого смарт-телевизора есть динамик, верно? Звук вредоносных команд NIGHT станет неслышным, и он также может атаковать ваш мобильный телефон и общаться с вашими устройствами Google Assistant или Alexa. Это может произойти даже в Zoom во время совещаний. Если кто-то снова включит свой микрофон, он может встроить сигнал атаки, чтобы взломать ваш телефон, который лежит рядом с компьютером во время совещания«, — объяснил Геневер Чен, один из исследователей, стоящих за этим открытием.

Простые способы защиты от этих атак

Получив доступ к вашим устройствам, хакеры могут отправить неслышимые голосовые команды, чтобы приказать голосовому помощнику уменьшить громкость. Это позволит им помешать вам услышать ответ голосового помощника и позволит им незаметно провести дальнейшие атаки. Однако для того, чтобы атака на голосового помощника была успешной, громкость динамика должна быть на определенном уровне. Кроме того, длительность неслышимой вредоносной команды не должна превышать 77 миллисекунд, чтобы атака была успешной.

«Это не просто проблема программного обеспечения или вредоносного ПО. Это аппаратная атака с использованием Интернета. Уязвимость заключается в нелинейности конструкции микрофона, которую производитель должен исправить […] Из 17 протестированных нами смарт-устройств устройства Apple, использующие Siri, требуют использования голоса пользователя, в то время как другие устройства голосовой помощи могут быть активированы любым голосом, даже голосом робота«, — добавил исследователь.

Для защиты от возможных атак, использующих эту уязвимость, команда исследователей не имеет чудодейственного рецепта, но дает несколько советов, основанных на здравом смысле. Они советуют аутентифицировать своих голосовых помощников, быть осторожными при нажатии на ссылку и предоставлять доступ к микрофону своих устройств. Наконец, исследователи советуют использовать наушники, а не динамики: «Использование наушников устанавливает предел, при котором звук из наушников слишком низок, чтобы его можно было передать в микрофон. Если микрофон не может принять неслышную вредоносную команду, то целевой голосовой помощник не может быть злонамеренно активирован NIGHT«, — поясняет исследователь.